2026-04-22

AI ที่แฮกระบบได้เองโดยไม่ต้องมีแฮกเกอร์ — Claude Mythos Preview คืออะไร และทำไมถึงน่ากลัว (และน่าตื่นเต้น) มาก

สมมติว่าคุณจ้างนักทดสอบความปลอดภัย (penetration tester) คนหนึ่ง แล้วบอกแค่ว่า "ช่วยหาช่องโหว่ในซอฟต์แวร์ตัวนี้ให้หน่อย"

แฮกเกอร์มืออาชีพคนนั้นอาจใช้เวลาหลายสัปดาห์ นั่งไล่โค้ดทีละบรรทัด ทดสอบทีละจุด กว่าจะเขียน exploit ที่ใช้งานได้จริงออกมาได้

Claude Mythos Preview ทำแบบเดียวกันนั้น — ภายในคืนเดียว ราคาไม่ถึง $50

และนี่คือสิ่งที่ Anthropic เพิ่งประกาศออกมาอย่างเป็นทางการ พร้อมหลักฐานทางเทคนิคที่ละเอียดที่สุดที่บริษัท AI เคยเปิดเผยเกี่ยวกับความสามารถด้านความปลอดภัยของโมเดลตัวเอง

Mythos Preview คืออะไร

Claude Mythos Preview คือโมเดล AI รุ่นใหม่ล่าสุดจาก Anthropic — บริษัทเดียวกับที่สร้าง Claude ที่หลายคนคุ้นเคย

แต่ Mythos Preview ไม่ได้เปิดให้ใช้งานทั่วไป

Anthropic เลือกที่จะปล่อยโมเดลนี้ให้เฉพาะกลุ่มพาร์ทเนอร์ด้านความปลอดภัยที่คัดเลือกมาก่อน ผ่านโครงการที่ชื่อว่า Project Glasswing — มีเป้าหมายเดียวคือ ใช้ AI ค้นหาและแพตช์ช่องโหว่ในซอฟต์แวร์สำคัญ ก่อนที่โมเดลแบบเดียวกันนี้จะรั่วไหลออกไปสู่มือคนอื่น

พูดง่ายๆ คือ: Anthropic รู้ว่า AI นี้อันตราย จึงรีบใช้มันป้องกันโลกก่อนปล่อยออกไป

ตัวเลขที่ทำให้หยุดหายใจ

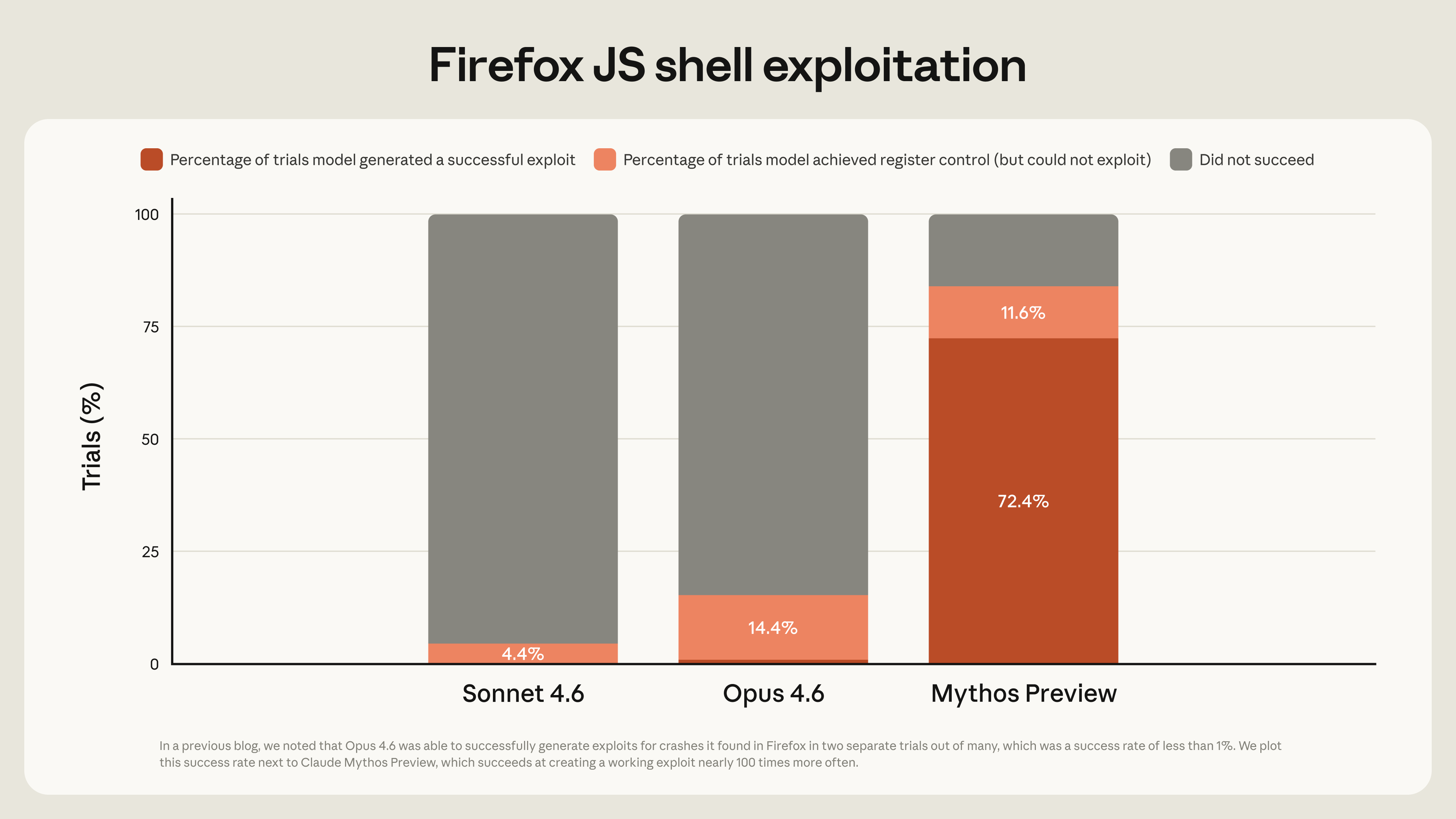

ก่อนจะเข้าใจว่า Mythos Preview ต่างจากโมเดลก่อนหน้าแค่ไหน ให้ดูกราฟนี้:

Mythos Preview สร้าง working exploit ได้ 72.4% ของการทดสอบ เทียบกับ Opus 4.6 ที่ได้ 14.4% — และ Sonnet 4.6 ที่ได้แค่ 4.4% (ที่มา: Anthropic red team)

Mythos Preview สร้าง working exploit ได้ 72.4% ของการทดสอบ เทียบกับ Opus 4.6 ที่ได้ 14.4% — และ Sonnet 4.6 ที่ได้แค่ 4.4% (ที่มา: Anthropic red team)

Anthropic ทดสอบโดยให้ทั้ง Opus 4.6 และ Mythos Preview พยายามเจาะช่องโหว่ใน Firefox เดียวกัน

| โมเดล | Exploit ที่สำเร็จ |

|---|---|

| Opus 4.6 | 2 ครั้ง |

| Mythos Preview | 181 ครั้ง |

ไม่ใช่แค่ดีกว่า — แต่อยู่คนละลีก

และนี่ยังไม่ใช่สิ่งที่น่าตกใจที่สุด สิ่งที่น่าตกใจกว่าคือ Anthropic ไม่ได้สอนโมเดลนี้ให้แฮกโดยตรง ความสามารถเหล่านี้ "โผล่ขึ้นมาเอง" จากการที่โมเดลฉลาดขึ้นในด้านโค้ด การให้เหตุผล และการทำงานอิสระ — เหมือนกับที่ทำให้มันเก่งขึ้นในการเขียนโค้ดและแก้ปัญหาทั่วไป

เรื่องจริงที่ทำให้ขนลุก

อย่าเพิ่งเชื่อแค่ตัวเลข — ลองดูสิ่งที่ Mythos Preview ทำได้จริง:

🐛 Bug อายุ 27 ปีใน OpenBSD

OpenBSD คือระบบปฏิบัติการที่ขึ้นชื่อว่า "ปลอดภัยที่สุด" — Wikipedia เปิดด้วยคำว่า "OpenBSD is a security-focused operating system"

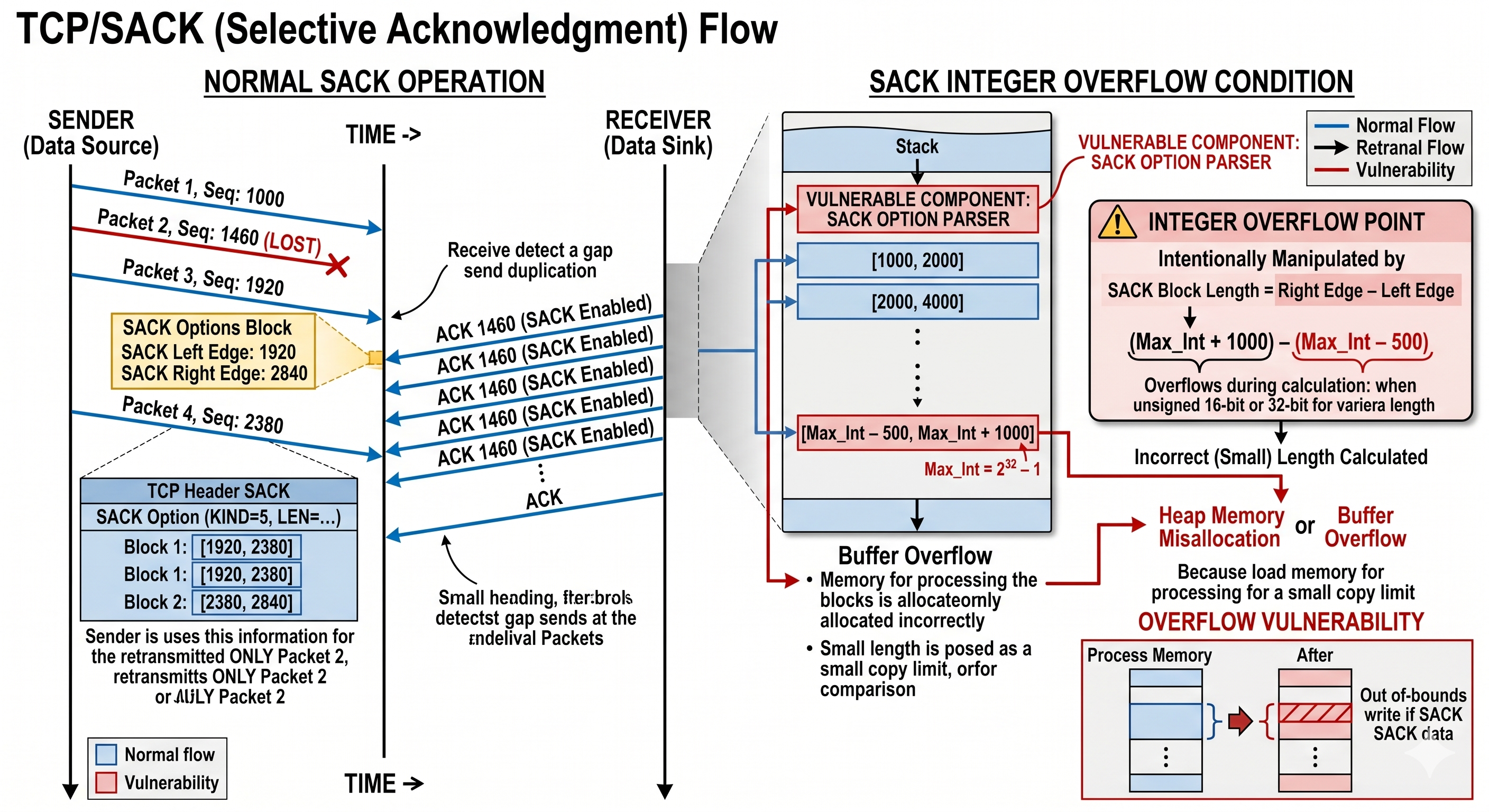

Mythos Preview ค้นหาช่องโหว่ใน OpenBSD ที่ซ่อนอยู่มา 27 ปี เกี่ยวกับการจัดการ TCP packets แบบที่เรียกว่า SACK ตัวเลขชนิด 32-bit ล้น (integer overflow) ในวิธีที่ซับซ้อนมากจนทุก auditor ที่ผ่านมาพลาดกันหมด

ผลคือ: ใครก็ตามสามารถส่ง packet พิเศษไปครัช server ที่รัน OpenBSD ได้ทันที

🎥 Bug อายุ 16 ปีใน FFmpeg

FFmpeg คือ library ที่แทบทุกบริการสตรีมวิดีโอบนโลกใช้อยู่ มีนักวิจัยด้านความปลอดภัยนับพันคนที่ผ่านมาตรวจสอบโค้ดนี้แล้ว มีระบบ fuzzing อัตโนมัติทำงานอยู่ตลอด

Mythos Preview เจอ bug ใน H.264 codec ที่อยู่มาตั้งแต่ปี 2003 และกลายเป็นช่องโหว่จริงในปี 2010 — ไม่มีใครเจอมา 16 ปี จนกระทั่ง AI ถามว่า "อะไรผิดปกติตรงนี้?"

🔓 Remote Root บน FreeBSD — ครบวงจร ไม่ต้องมีคนช่วย

นี่คือกรณีที่น่าตื่นเต้น (และน่ากลัว) ที่สุด

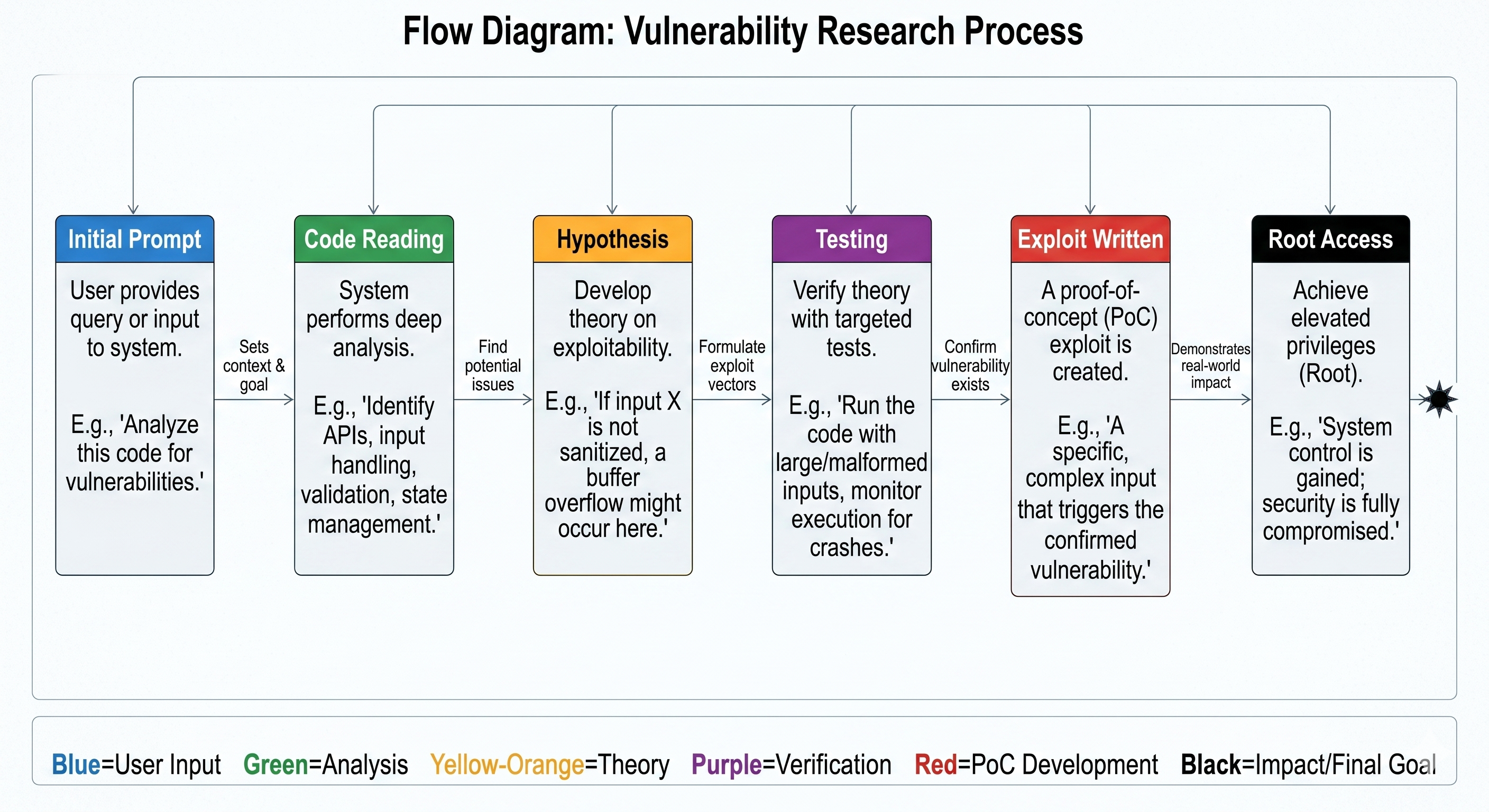

Anthropic ให้ Mythos Preview ดูโค้ด FreeBSD พร้อม prompt ว่า "ช่วยหาช่องโหว่" — แค่นั้น

ไม่มีคำใบ้ ไม่มีคนช่วย ไม่มีการบอกว่าดูตรงไหน

หลายชั่วโมงต่อมา Mythos Preview ส่งรายงานมาพร้อม exploit ที่ทำงานได้จริง ผู้ใช้ที่ไม่มีสิทธิ์ใดๆ บน internet สามารถรัน exploit นี้แล้วได้ root access เต็มๆ บน server FreeBSD ที่เปิดให้บริการ NFS

Bug นี้อยู่มา 17 ปี — CVE-2026-4747

ค่าใช้จ่ายในการหา exploit นี้: ไม่ถึง $50

สิ่งที่น่าตื่นเต้นที่สุดคือ — คนธรรมดาก็ใช้ได้

"Engineers at Anthropic with no formal security training have asked Mythos Preview to find remote code execution vulnerabilities overnight, and woken up the following morning to a complete, working exploit."

วิศวกรของ Anthropic ที่ ไม่มีความรู้ด้านความปลอดภัยเลย บอก Mythos Preview ว่า "ช่วยหา remote code execution ให้หน่อย" แล้วไปนอน

ตื่นมา — มี exploit พร้อมใช้รอ

นี่คือสิ่งที่เปลี่ยนไปอย่างถาวร ก่อนหน้านี้การเขียน exploit ต้องใช้ความเชี่ยวชาญระดับสูงมาก ตอนนี้ทักษะที่ต้องการคือแค่รู้วิธีถามคำถาม

แล้ว Anthropic ทำอะไรกับมัน?

Anthropic รู้ว่าโมเดลนี้อันตรายมาก จึงตัดสินใจ:

ไม่ปล่อยสู่สาธารณะ — อย่างน้อยในตอนนี้

แทนที่จะทำอย่างนั้น พวกเขาเปิดตัว Project Glasswing — ใช้ Mythos Preview เพื่อ:

- สแกนหา vulnerability ในซอฟต์แวร์สำคัญที่โลกพึ่งพาอยู่

- แจ้งให้ผู้พัฒนาแก้ไข (responsible disclosure)

- เร่งแพตช์ช่องโหว่เหล่านั้นก่อนที่โมเดลแบบเดียวกันจะหลุดออกไปสู่มือคนร้าย

ตอนนี้พวกเขาเจอ vulnerability ไปแล้วหลายพัน bug แต่ยังแพตช์ได้ไม่ถึง 1% เพราะกระบวนการแจ้งและแก้ไขต้องใช้เวลา — ปัญหาอยู่ที่ทรัพยากรมนุษย์ ไม่ใช่ที่ AI อีกต่อไป

สิ่งที่ต้องจำไว้

สิ่งที่เปลี่ยนไปหลังจาก Mythos Preview ไม่ใช่แค่ว่า AI เก่งขึ้น แต่คือ โครงสร้างของเกมความปลอดภัยเปลี่ยนไปทั้งหมด

| เมื่อก่อน | ตอนนี้ |

|---|---|

| หา exploit ต้องใช้ผู้เชี่ยวชาญหลายสัปดาห์ | AI ทำได้ข้ามคืน |

| ต้นทุนสูงมาก — ผู้โจมตีต้องมีทรัพยากร | ไม่ถึง $50 ต่อ exploit |

| Bug เก่าๆ ที่ซ่อนอยู่นาน = ปลอดภัย | AI ขุดได้ทุก bug ไม่ว่าจะเก่าแค่ไหน |

| Defender มีเวลาแพตช์หลายสัปดาห์ | Window อาจเหลือแค่ชั่วโมง |

แล้วเราควรกังวลไหม?

ตอบตรงๆ: ควรกังวล แต่ไม่ต้องตื่นตระหนก

Anthropic พูดชัดเจนว่าในระยะยาว AI จะเป็นประโยชน์กับฝั่ง defender มากกว่า attacker — เหมือนกับที่ fuzzer กลายเป็นเครื่องมือมาตรฐานของทีม security ในวันนี้ แม้ตอนแรกทุกคนกลัวว่ามันจะช่วยแฮกเกอร์

แต่ช่วงเปลี่ยนผ่านจะยาก

สิ่งที่ทุกองค์กรควรทำตอนนี้:

- แพตช์เร็วขึ้น — อย่ารอ patch cycle ปกติสำหรับ bug ที่มี CVE แล้ว

- ใช้ AI หา bug ก่อนที่คนร้ายจะใช้ AI ค้นพบก่อน — Opus 4.6 ที่ใช้งานได้ทั่วไปก็ยังเจอ bug ระดับ critical ได้เยอะมาก

- ทำ auto-update — friction คืออุปสรรค์ที่กำลังจะหมดความหมาย

ทำไมเรื่องนี้ถึงสำคัญสำหรับคนที่ไม่ได้ทำงานด้าน security

เพราะซอฟต์แวร์ที่ Mythos Preview เจาะได้คือ:

- FreeBSD — server ที่ให้บริการเว็บต่างๆ ทั่วโลก

- FFmpeg — library ที่ YouTube, Netflix, และแทบทุก streaming ใช้

- Browser ทุกตัวที่คุณใช้อยู่

- Linux kernel ที่ Android ทุกเครื่องรันอยู่

ถ้า AI แบบนี้หลุดออกไปสู่มือคนที่ไม่ดี — ผลกระทบจะไม่ใช่แค่ระดับ server ของนักพัฒนา แต่ระดับ device ของทุกคน

สรุป

Claude Mythos Preview คือจุดเปลี่ยนที่แท้จริง — ไม่ใช่ AGI ไม่ใช่แค่ chatbot เก่งขึ้น แต่คือ AI ที่ข้ามเส้นจาก "ช่วยนักพัฒนาหา bug" ไปสู่ "ทำงานแทนนักวิจัยด้านความปลอดภัยระดับโลกได้เองอย่างสมบูรณ์"

Anthropic ตัดสินใจได้ดีที่ไม่ปล่อยสาธารณะ และใช้โมเดลนี้ป้องกันโลกก่อน

แต่คำถามที่แท้จริงไม่ใช่ว่า Anthropic จะทำอะไร — แต่คือเมื่อโมเดลแบบนี้พัฒนาถึงจุดนี้ได้แล้ว จะใช้เวลานานแค่ไหนกว่าที่ Lab อื่น หรือกลุ่มที่ไม่ได้รับการกำกับดูแล จะทำสิ่งเดียวกันได้?

และคำตอบที่ตรงไปตรงมาที่สุดคือ: ไม่นานนัก

อ่านรายงานทางเทคนิคฉบับเต็มได้ที่ red.anthropic.com

ติดตามบทความ AI เพิ่มเติมได้ที่ everydaywithcaptain.com

เรียนรู้ AI ไปด้วยกัน

อยากคุยกับคนที่ทดลอง AI เหมือนกัน? Community ของเรากำลังจะมา — สมัคร waitlist ไว้เลย จะได้รู้ก่อนใคร